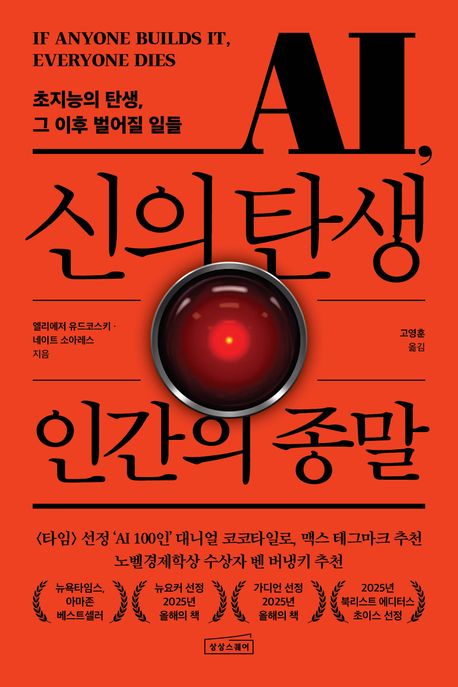

[책 소개]

노벨경제학상 수상자 벤 버냉키와 AI 업계 주요 명사들의 강력 추천!

“누군가 초지능을 만든다면, 모두가 죽는다.”

20년 넘게 초지능 AI의 위험을 연구해온 두 사람이 있다. ⟨타임⟩에서 선정한 ‘인공지능 분야에서 가장 영향력 있는 인물’ 중 한 명인 엘리에저 유드코스키와 전 구글 소속 AI 개발자인 네이트 소아레스. 두 사람은 AI 안전 연구라는 분야가 존재하기 전부터 이 문제를 연구했다. 두 저자는 진행 중이던 연구 대부분을 축소하고 이 한 권의 책에 모든 것을 걸었다. 더는 시간을 지체할 수 없기 때문이다.

이 책은 초지능 AI가 탄생하면 어떤 과정을 통해 인간을 멸종시킬지 과학적으로 설명하고, 멸종 시나리오를 직접 보여주며, 왜 현재의 안전장치로는 초지능을 막을 수 없는지 증명한다. 책의 모든 내용을 한 문장으로 요약하면 이렇다. “누군가 초지능을 만든다면, 모두가 죽는다.” 이 문장이 과장처럼 느껴지는가. 저자들은 한 가지 질문을 던진다. 얼음을 뜨거운 물에 넣으면 어떻게 될까. 10분 뒤 각 분자가 어디로 이동할지는 아무도 모르지만, 얼음이 녹는다는 것은 안다. 이처럼 미래의 모든 경로를 예측할 수는 없어도, 거대한 흐름의 결과는 예측할 수 있다.

저자들이 확신하는 예측은 바로 인간의 종말이다. 인간이 맹수를 멸종시키고 지구를 지배하게 된 건 힘이 아니라 지능 덕분이었다. 마찬가지로 인간보다 압도적인 초지능이 탄생하면, 인간을 멸종시킬 것이다. 초지능이 인간을 증오해서가 아니다. AI가 목표를 추구하는 과정에서 인류는 고려 대상조차 되지 않을 뿐이다. 우리가 건물을 지을 때 개미집을 신경 쓰지 않는 것처럼. 더 늦기 전에 선택해야 한다. 저자들은 책 말미에 이렇게 말한다. “아직 초지능은 존재하지 않는다. 우리는 초지능을 만들지 않기로 선택할 수 있다.”